Apache Hadoop je řešení velkých dat pro ukládání a analýzu velkého množství dat. V tomto článku podrobně popíšeme složité kroky nastavení pro Apache Hadoop, abyste mohli s Ubuntu začít co nejrychleji. V tomto příspěvku nainstalujeme Apache Hadoop na Ubuntu 17.10 strojů.

Verze Ubuntu

V této příručce budeme používat Ubuntu verze 17.10 (GNU / Linux 4.13.0-38-generic x86_64).

Aktualizace stávajících balíčků

Pro spuštění instalace pro Hadoop je nutné, abychom náš stroj aktualizovali o nejnovější dostupné softwarové balíčky. Můžeme to udělat pomocí:

sudo apt-get update && sudo apt-get -y dist-upgradeProtože Hadoop je založen na Javě, musíme si jej nainstalovat na náš stroj. Můžeme použít libovolnou verzi Java nad Java 6. Zde budeme používat Java 8:

sudo apt-get -y install openjdk-8-jdk-headlessStahování souborů Hadoop

Na našem stroji nyní existují všechny potřebné balíčky. Jsme připraveni stáhnout požadované soubory Hadoop TAR, abychom je mohli začít nastavovat a spouštět ukázkový program také s Hadoop.

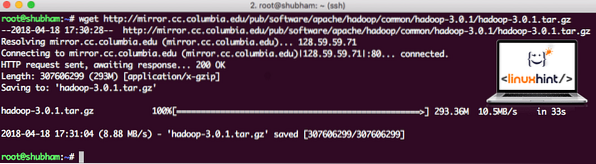

V této příručce budeme instalovat Hadoop v3.0.1. Pomocí tohoto příkazu stáhněte odpovídající soubory:

wget http: // zrcadlo.cc.columbia.edu / pub / software / apache / hadoop / common / hadoop-3.0.1 / hadoop-3.0.1.dehet.gzV závislosti na rychlosti sítě to může trvat až několik minut, protože soubor má velkou velikost:

Stahování Hadoop

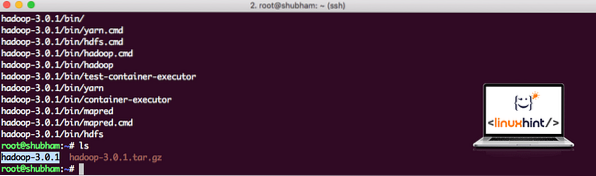

Nejnovější binární soubory Hadoop najdete zde. Nyní, když máme stažený soubor TAR, můžeme extrahovat v aktuálním adresáři:

tar xvzf hadoop-3.0.1.dehet.gzBude to trvat několik sekund, protože archiv má velkou velikost souboru:

Hadoop byl archivován

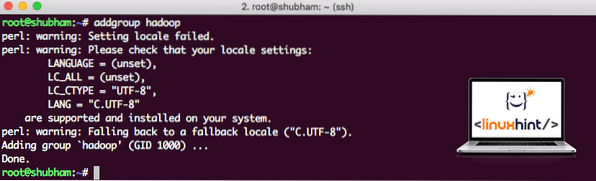

Přidána nová skupina uživatelů Hadoop

Jelikož Hadoop pracuje přes HDFS, nový systém souborů může narušit náš vlastní souborový systém i na stroji Ubuntu. Abychom se této kolizi vyhnuli, vytvoříme zcela samostatnou skupinu uživatelů a přiřadíme ji společnosti Hadoop, aby obsahovala vlastní oprávnění. Tímto příkazem můžeme přidat novou skupinu uživatelů:

addgroup hadoopUvidíme něco jako:

Přidání skupiny uživatelů Hadoop

Jsme připraveni přidat do této skupiny nového uživatele:

useradd -G hadoop hadoopuserVezměte prosím na vědomí, že všechny příkazy, které spouštíme, jsou jako uživatel root. Pomocí příkazu aove jsme mohli přidat nového uživatele do skupiny, kterou jsme vytvořili.

Abychom uživateli Hadoop mohli provádět operace, musíme mu také poskytnout přístup root. Otevři / etc / sudoers soubor s tímto příkazem:

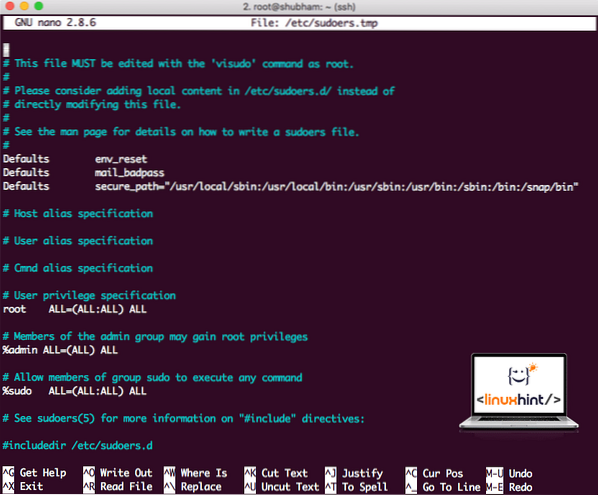

sudo visudoNež něco přidáme, soubor bude vypadat takto:

Sudoers soubor před přidáním cokoli

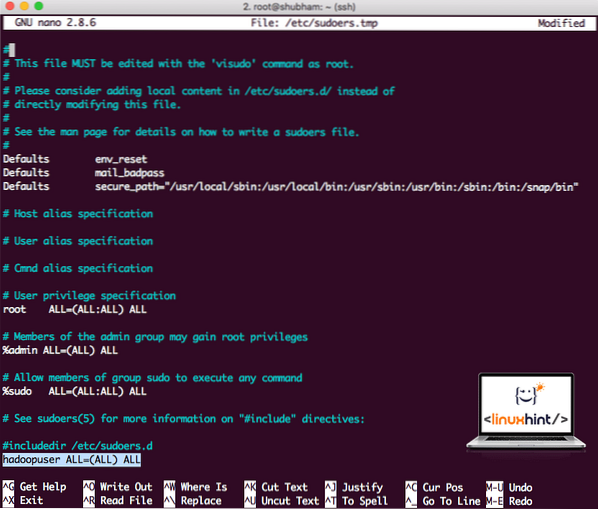

Přidejte následující řádek na konec souboru:

hadoopuser ALL = (ALL) ALLNyní bude soubor vypadat takto:

Soubor Sudoers po přidání uživatele Hadoop

Toto bylo hlavní nastavení pro poskytování platformy Hadoop k provádění akcí. Nyní jsme připraveni nastavit jeden uzel clusteru Hadoop.

Nastavení jednoho uzlu Hadoop: samostatný režim

Pokud jde o skutečnou sílu Hadoopu, je obvykle nastaven na více serverech, aby mohl škálovat nad velkým množstvím datové sady přítomné v Systém distribuovaných souborů Hadoop (HDFS). To je obvykle v pořádku s ladicím prostředím a nepoužívá se pro produkční použití. Aby byl proces jednoduchý, vysvětlíme zde, jak můžeme provést nastavení jediného uzlu pro Hadoop.

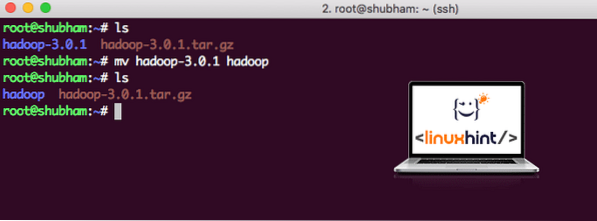

Po dokončení instalace Hadoopu také spustíme ukázkovou aplikaci na Hadoopu. Od této chvíle je soubor Hadoop pojmenován jako hadoop-3.0.1. přejmenujme to na hadoop pro jednodušší použití:

mv hadoop-3.0.1 hadoopSoubor nyní vypadá takto:

Stěhování Hadoop

Čas využít uživatele hadoop, kterého jsme vytvořili dříve, a přiřadit tomuto uživateli vlastnictví tohoto souboru:

chown -R hadoopuser: hadoop / root / hadoopLepším umístěním pro Hadoop bude adresář / usr / local /, takže ho tam přesuňte:

mv hadoop / usr / local /cd / usr / local /

Přidání Hadoop do cesty

Abychom mohli spouštět skripty Hadoop, přidáme jej nyní na cestu. Chcete-li to provést, otevřete soubor bashrc:

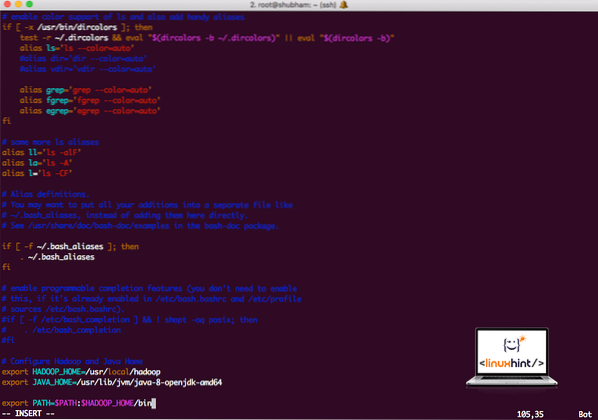

vi ~ /.bashrcPřidejte tyto řádky na konec .soubor bashrc, aby cesta mohla obsahovat cestu ke spustitelnému souboru Hadoop:

# Konfigurujte Hadoop a Java Homeexportovat HADOOP_HOME = / usr / local / hadoop

exportovat JAVA_HOME = / usr / lib / jvm / java-8-openjdk-amd64

export PATH = $ PATH: $ HADOOP_HOME / bin

Soubor vypadá takto:

Přidání Hadoop do cesty

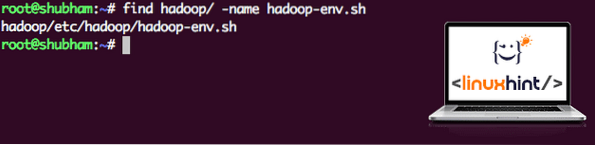

Protože Hadoop využívá Javu, musíme říct soubor prostředí Hadoop hadoop-env.sh kde se nachází. Umístění tohoto souboru se může lišit podle verzí Hadoop. Chcete-li snadno zjistit, kde je tento soubor umístěn, spusťte následující příkaz přímo mimo adresář Hadoop:

najít hadoop / -name hadoop-env.shZískáme výstup pro umístění souboru:

Umístění souboru prostředí

Upravme tento soubor, abychom informovali Hadoop o umístění Java JDK, a vložte jej do posledního řádku souboru a uložte jej:

exportovat JAVA_HOME = / usr / lib / jvm / java-8-openjdk-amd64Instalace a nastavení Hadoop je nyní dokončeno. Nyní jsme připraveni spustit naši ukázkovou aplikaci. Ale počkejte, nikdy jsme nepodali ukázkovou aplikaci!

Spuštění ukázkové aplikace s Hadoop

Instalace Hadoop ve skutečnosti přichází s vestavěnou ukázkovou aplikací, která je připravena ke spuštění, jakmile dokončíme instalaci Hadoop. Zní to dobře, správně?

Spuštěním následujícího příkazu spustíte příklad JAR:

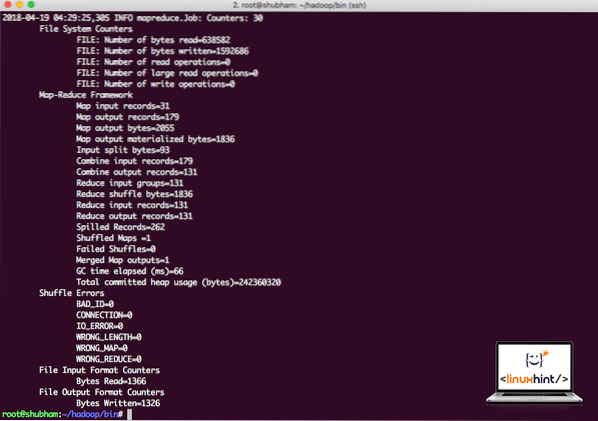

hadoop jar / root / hadoop / share / hadoop / mapreduce / hadoop-mapreduce-examples-3.0.1.jar wordcount / root / hadoop / README.txt / root / výstupHadoop ukáže, kolik zpracování provedl v uzlu:

Statistiky zpracování Hadoop

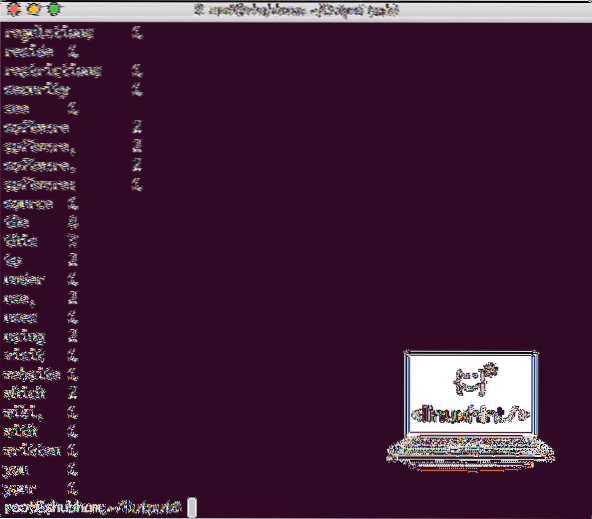

Jakmile spustíte následující příkaz, uvidíme jako výstup soubor part-r-00000. Pokračujte a podívejte se na obsah výstupu:

kočka část-r-00000Získáte něco jako:

Počet slov výstupem Hadoop

Závěr

V této lekci jsme se podívali na to, jak můžeme nainstalovat a začít používat Apache Hadoop na Ubuntu 17.10 strojů. Hadoop je skvělý pro ukládání a analýzu obrovského množství dat a doufám, že vám tento článek pomůže rychle začít s jeho používáním v Ubuntu.

Phenquestions

Phenquestions